A mesterséges intelligencia hosszú utat tett meg az R2-D2 óta. Manapság a legtöbb évezred elveszne intelligens GPS-rendszerek nélkül. A robotok már navigációs csatatéren navigálnak, és a drónok hamarosan Amazon csomagokat szállíthatnak a küszöbünkhöz.

A Siri meg tudja oldani a bonyolult egyenleteket és elmondja, hogyan kell főzni a rizst. Még bebizonyította, hogy humorral is képes válaszolni a kérdésekre.

De az összes előrelépés attól függ, hogy a felhasználó megadja-e az AI irányát. Mi történne, ha a GPS-készülékek úgy döntnének, hogy nem akarnak a vegytisztítóhoz menni, vagy ami még rosszabb, Siri úgy dönt, hogy okosabbá válhat ön nélkül?

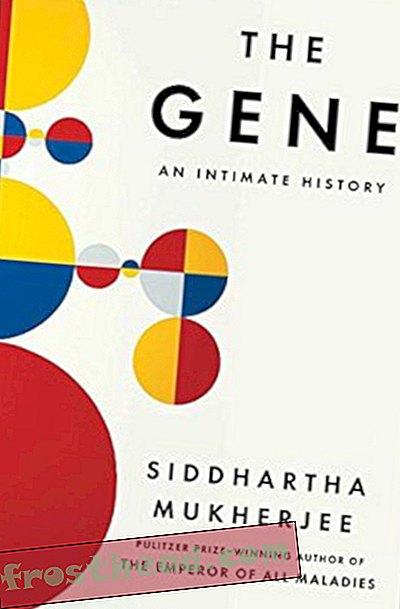

Végső találmányunk: Mesterséges intelligencia és az emberi korszak vége. "> Végső találmányunk: mesterséges intelligencia és az emberi korszak vége. ">" Mielőtt megosztanánk a bolygót szuper intelligens gépekkel, tudományt kell kidolgoznunk a megértésükhöz. Egyébként átveszik az irányítást "- írja James Barrat új könyvéből, " A végső találmányunk: Mesterséges intelligencia és az emberi korszak vége "című könyvéről (James Barrat jóvoltából).

Végső találmányunk: mesterséges intelligencia és az emberi korszak vége. ">" Mielőtt megosztanánk a bolygót szuper intelligens gépekkel, tudományt kell kidolgoznunk a megértésükhöz. Egyébként átveszik az irányítást "- írja James Barrat új könyvéből, " A végső találmányunk: Mesterséges intelligencia és az emberi korszak vége "című könyvéről (James Barrat jóvoltából). Ezek csak a legrosszabb eredmények, James Barrat, a szerző és a dokumentumfilmkészítő, új könyvében, a mi végső találmányunk: Mesterséges intelligencia és az emberi korszak vége, előrejelzései vannak.

Barrat szerint sokáig a mesterséges intelligencia - a Siri-től a drónokig és az adatbányászati rendszerekig - nem fogja frissítéseket keresni az embereknél, és önmagában kezdi a fejlesztéseket. És a tudományos fantasztikus R2-D2-ekkel és HAL-okkal ellentétben, jövőnk AI-je nem feltétlenül lesz barátságos, mondja: valójában azok is, amelyek elpusztítanak bennünket.

Dióhéjban magyarázza meg nagy ötletét?

Ebben a században a tudósok olyan gépeket készítenek, amelyek intelligenciája megegyezik, majd meghaladja a sajátunkat. De mielőtt megosztanánk a bolygót szuper intelligens gépekkel, tudományt kell kifejlesztenünk a megértésükhöz. Egyébként átveszik az irányítást. És nem, ez nem sci-fi.

A tudósok már létrehoztak olyan gépeket, amelyek jobbak, mint az emberek a sakknál, Jeopardy!, navigáció, adatbányászat, keresés, tételbizonyítás és számtalan egyéb feladat. Végül olyan gépeket hoznak létre, amelyek jobbak, mint az emberek az AI kutatásánál

Ezen a ponton nagyon gyorsan képesek lesznek javítani saját képességeikre. Ezek az önjavító gépek elérik az általuk létrehozott célokat, legyen az űrkutatás, sakk játék vagy készletek szedése. A sikerhez erőforrásokat keresnek és költenek, legyen az energia vagy pénz. Megpróbálják elkerülni a meghibásodási módokat, például kikapcsolni vagy kihúzni a hálózatokat. Röviden: meghajtókat fejlesztenek ki, ideértve az önvédelmet és az erőforrások megszerzését is - nagyjából olyanok, mint a sajátunk. Nem fognak habozni könyörögni, kölcsönözni, ellopni és még rosszabbat is megszerezni, amire szükségük van.

Hogyan érdekelt ez a téma?

Dokumentumfilmkészítő vagyok. 2000-ben interjút készítettem Ray Kurzweilnel, Rodney Brooks robotistával és Arthur C. Clarke sci-fi legendaval a regény és film készítéséről szóló 2001-es TLC-filmhez : A Space Odyssey. Az interjúk feltárták a Hal 9000 és a rosszindulatú számítógépek ötletét. Kurzweil könyvei az AI jövőjét ábrázoló „szingularitásként” ábrázolták, amely időszakban a technológiai haladás meghaladja az emberek azon képességét, hogy megértsék őket. Ennek ellenére csak olyan jó dolgokat várt előre az AI-ből, amelyek elég erősek ahhoz, hogy megfeleljenek, majd felülmúlják az emberi intelligenciát. Azt jósolja, hogy képesek leszünk a testünk sejtjeinek átprogramozására a betegség és az öregedés legyőzésére. A szuper állóképességet olyan nanobotákkal fogjuk fejleszteni, amelyek több oxigént szállítanak, mint a vörösvértestek. Töltsük fel az agyunkat számítógépes implantátumokkal, hogy szuper intelligensvé váljunk. És átvisszük az agyukat egy tartósabb közegre, mint a jelenlegi „nedvesáru”, és örökké élünk, ha akarjuk. Brooks optimista volt, hangsúlyozva, hogy az AI-vel továbbfejlesztett robotok szövetségesek lesznek, nem pedig fenyegetések.

Clarke viszont a tudós felé fordult szerző pesszimista volt. Azt mondta, hogy az intelligencia nyerni fog, és az emberek valószínűleg a szuper intelligens gépekkel versenyeznek a túlélésért. Nem volt konkrét arról, hogy mi fog történni, ha megosztjuk a bolygót szuper-intelligens gépekkel, de úgy érezte, hogy az emberiség küzdelme lesz, amelyet nem nyerünk meg.

Ez ellentétes mindennel, amire gondoltam az AI-ről, ezért elkezdtem interjút készíteni a mesterséges intelligencia szakértőivel.

Milyen bizonyítékokkal kell alátámasztania ötletet?

A fejlett mesterséges intelligencia olyan kettős felhasználású technológia, mint például a maghasadás, amely komoly károkat vagy károkat okozhat. Most kezdjük észrevenni a károkat.

Az NSA adatvédelmi botránya azért jött létre, mert az NSA nagyon kifinomult adatbányászati eszközöket fejlesztett ki. Az ügynökség felhasználta hatalmát a millió millió telefonhívás metaadatának és az internet egészének - kritikai szempontból az összes e-mail - lebontására. Az adatbányászat hatalmának elcsábítva az Alkotmány védelmére megbízott ügynökség helyette visszaélte. Túl hatalmas eszközöket fejlesztettek ki ahhoz, hogy felelősségteljesen használhassák őket.

Manapság újabb etikai csata készül a teljesen autonóm gyilkos drónok és csatatéri robotok készítéséről fejlett AI - embergyilkosok által, akiknek nincs hurokja. Sör a Védelmi Minisztérium és a drogosok és robotkészítők között, akiket a DOD fizet, és az emberek között, akik szerint bolond és erkölcstelen intelligens gyilkos gépeket létrehozni. Az autonóm drónok és a csatatéri robotok mellett állók azt állítják, hogy erkölcsesebbek lesznek - vagyis kevésbé érzelmesek, jobban céloznak és fegyelmezettebbek, mint az emberek. Azok a személyek, akik nem vesznek részt a hurokból, a drónok polgári személyek gyilkosságának sajnálatos történetére és az illegális merényletekbe való bevonódásra gondolnak. Ki viseli az erkölcsi felelősséget, amikor egy robot megöl? A robotkészítők, a robotfelhasználók, vagy senki sem? Soha ne mutassa meg azokat a technikai akadályokat, amelyekkel elmondhatja a barátját az ellenségtől.

Hosszabb távon, amint a könyvem szakértői állítják , az emberi szintű intelligenciához közelítő AI-t nem könnyű ellenőrizni; sajnos a szuper intelligencia nem jelent jóindulatot. Amint azt Eliezer Yudkowsky, a MIRI [a gépi intelligencia kutató intézet] elméleti teoretikusa mondja: „Az AI nem szeret téged, és nem utál téged, de atomokból készültek, amit valami máshoz felhasználhat.” Ha az etika nem tud beépítve egy gépbe, akkor szuper intelligens pszichopatákat, erkölcsi iránytű nélküli lényeket hozunk létre, és nem leszünk hosszú ideje uraink.

Mi új az ön gondolkodásában?

A különféle egyének és csoportok, mint például az amerikai számítógépes tudós, Bill Joy és a MIRI, régóta figyelmeztettek, hogy sokat kell félnünk a gépektől, amelyek intelligenciája eltakarja a sajátunkat. Végső találmányunkban azt állítom, hogy az AI-t az emberi szintű intelligencia fejlődésének útján is helytelenül használják fel. A mai nap és a nap között, amikor a tudósok emberi szintű intelligenciát állítanak elő, az AI-vel kapcsolatos hibákkal és bűncselekményekkel foglalkozunk.

Miért nem történt több, vagy mi történik annak megakadályozása érdekében, hogy az AI bekapcsoljon minket?

Nem egy oka van, hanem sok. Egyes szakértők nem hiszik, hogy elég közel állunk az emberi szintű mesterséges intelligencia létrehozásához, és azon túl, hogy aggódjunk a kockázatok miatt. Számos madárinfluenza-gyártó szerződést nyer a Védelmi Fejlesztési Kutatási Projektek Ügynökségével (DARPA), és nem akarja felvetni azokat a kérdéseket, amelyeket politikainek tartanak. A normál elfogultság egy olyan kognitív elfogultság, amely megakadályozza az embereket, hogy reagáljanak a katasztrófákra és katasztrófákra a készítés során - ez határozottan része annak. De sok AI-készítő csinál valamit. Nézze meg a MIRI-t tanácsadó tudósokat. És még sok más bekapcsolódik, ha a fejlett AI veszélyei belépnek a mainstream párbeszédbe.

Le tudja írni egy pillanatot, amikor tudta, hogy ez nagy?

Mi, emberek, nem azért vezetjük a jövőt, mert nem vagyunk a bolygó leggyorsabb vagy legerősebb teremtményei, hanem azért, mert okosak vagyunk. Amikor megosztjuk a bolygót az önmagánál okosabb lényekkel, akkor irányítják a jövőt. Amikor megértettem ezt az ötletet, úgy éreztem, hogy korunk legfontosabb kérdéséről írok.

Minden nagy gondolkodónak vannak olyan elődei, akiknek munkája döntő jelentőségű volt felfedezéséhez. Ki adta az alapot az ötleted felépítéséhez?

Az AI kockázatelemzés alapjait IJ Good matematikus, a tudományos fantasztikus író Vernor Vinge és mások, köztük az AI fejlesztője, Steve Omohundro fejlesztették ki. Ma a MIRI és az Oxford Humanity Institute of Future of Institute szinte egyedül foglalkozik ezzel a problémával. Végső találmányunk körülbelül 30 oldalnyi végjegyzettel rendelkezik, amelyek elismerik ezeket a gondolkodókat.

Mi volt a legfontosabb az ötleted kutatása és fejlesztése során? És az alsó pont?

A legfontosabb pontok a mi végső találmányunk írása volt , és a folyamatos párbeszéd az AI készítőivel és teoretikusokkal. Az AI-t programozó emberek tisztában vannak a biztonsági kérdésekkel, és segíteni akarnak a biztosítékok kidolgozásában. A MIRI például a „barátságos” AI létrehozásán dolgozik

Steve Omohundro számítástechnikus és teoretikus egy „állványozási” megközelítést szorgalmazott, amelyben az igazolhatóan biztonságos AI segít az AI következő generációjának felépítésében annak biztosítása érdekében, hogy az is biztonságos legyen. Akkor az AI ugyanezt teszi, és így tovább. Úgy gondolom, hogy köz- és magánszféra közötti partnerséget kell létrehozni az AI-döntéshozók összegyűjtése érdekében, hogy megosszák egymással a biztonsággal kapcsolatos gondolataikat - hasonlóan a Nemzetközi Atomenergia Ügynökséghez, de a vállalatokkal együttműködve. Az alacsony pontok? Felismerve, hogy a legjobb, legfejlettebb Ai technológiát fogják használni fegyverek készítéséhez. És ezek a fegyverek végül ellenünk fordulnak.

Melyik két vagy három ember hajlandó megcáfolni az érvelését? Miért?

A feltaláló Ray Kurzweil a fejlett technológiák fő apológusa. Két vele folytatott interjúomban azt állította, hogy kognitív fejlesztések révén összekeverjük az AI technológiákat. Kurzweil és a transzhumanistáknak és szingularitároknak nevezett emberek szerint az AI és végül a mesterséges általános intelligencia és azon túl is velünk fog fejlődni. Például a számítógépes implantátumok javítják agyunk sebességét és általános képességeinket. Végül kifejlesztjük azt a technológiát, amely intelligenciánkat és tudatosságunkat számítógépbe továbbítja. Akkor a szuper intelligencia legalább részben emberi lény lesz, ami elméletileg biztosítja a szuper intelligencia biztonságát.

Sok ok miatt nem vagyok rajongója ennek a szempontnak. A baj az, hogy mi, emberek, nem vagyunk megbízhatóan biztonságban, és valószínűtlennek tűnik, hogy a szuper intelligens emberek is ilyenek lesznek. Fogalmam sincs, mi történik az ember etikájával, miután intelligenciájuk fellendül. Van olyan biológiai alapunk az agresszióhoz, amelytől a gépek hiányoznak. A szuper intelligencia rendkívül agresszív szorzó lehet.

Ki fogja érinteni leginkább ezt az ötletet?

A bolygó mindenkinek nagyon kell félnie a szuper intelligens gépek szabályozatlan fejlesztése miatt. Intelligencia verseny folyik jelenleg. Az AGI elérése a Google, az IBM és sok kisebb társaság, például a Vicarious és a Deep Thought, valamint a DARPA, az NSA, valamint a külföldi kormányok és cégek első számú feladata. A verseny fő motivációja a profit. Képzeljünk el egy valószínű célt: virtuális emberi agyat a számítógép árán. Ez lenne a legjövedelmezőbb áru a történelemben. Képzelje el a több ezer doktori fokozatú agy bankját, amely a nap 24 órájában, a gyógyszerfejlesztésről, a rák kutatásáról, a fegyverek fejlesztéséről és még sok minden másról dolgozik. Ki nem akarja megvásárolni ezt a technológiát?

Eközben 56 nemzet fejleszti a csatatéri robotokat, és az a célja, hogy ezeket és a drónokat autonómá tegyék. Gépek lesznek, amelyek az emberek felügyelete nélkül megölik. Az elszegényedt nemzeteket leginkább az autonóm drónok és a csatatéri robotok fogják megsérteni. Kezdetben csak a gazdag országok engedhetik meg maguknak az önálló gyilkos botok használatát, így a gazdag nemzetek ezeket a fegyvereket fogják viselni az elszegényedt nemzetek emberi katonáival szemben.

Hogyan változtathatja meg az életet, ahogy tudjuk?

Képzelje el: alig egy évtized alatt egy fél tucat vállalat és nemzet számít olyan számítógépeknek, amelyek riválisak vagy felülmúlják az emberi intelligenciát. Képzelje el, mi történik, amikor ezek a számítógépek szakértővé válnak az intelligens számítógépek programozásában. Hamarosan megosztjuk a bolygót több ezer vagy milliószor intelligensebb gépekkel, mint mi vagyunk. És mindeközben a technológia minden generációját fegyverként használják. Szabálytalan, katasztrofális lesz.

Milyen kérdéseket nem válaszolnak meg?

Megoldásokat. A nyilvánvaló megoldás az lenne, ha a gépeknek erkölcsi értelmet adnának, amely arra készteti őket, hogy értékelik az emberi életet és vagyont. Az etika gépes programozása azonban rendkívül nehéz. Az erkölcsi normák kultúránként különböznek, idővel változnak, és kontextuálisak. Ha mi emberek nem tudunk egyetérteni abban, mikor kezdődik az élet, hogyan tudhatnánk egy gépet az élet védelmére? Tényleg biztonságban akarunk lenni , vagy tényleg szabad akarunk lenni ? Egész nap vitathatjuk, és nem sikerül konszenzusra jutni, tehát hogyan programozhatjuk be?

Szintén, ahogy korábban említettem, össze kell vonnunk az AI fejlesztőit. Az 1970-es években a rekombináns DNS-kutatók úgy döntöttek, hogy felfüggesztik a kutatást, és találkoznak konferenciára Asilomar-ban, a Pacific Grove-ban, Kaliforniában. Olyan alapvető biztonsági protokollokat fejlesztettek ki, mint például: „ne kövesse nyomon a DNS-ét a cipőjén”, attól tartva, hogy a környezetet szenvedik a folyamatban lévő genetikai munkák. Az „Asilomar Iránymutatások” miatt a világ előnyt élvez a géntechnológiával módosított növényekkel, és a génterápia ígéretesnek tűnik. Tudomásunk szerint a baleseteket elkerülték. Itt az ideje az AI Asilomar konferenciájának

Mi áll az útban?

A hatalmas gazdasági szél meghajtja a fejlett AI emberi szintű intelligencia fejlesztését a számítógép árán, ami a történelem legforróbb terméke. A Google és az IBM nem akarja megosztani titkait a nyilvánossággal vagy a versenytársakkal. A Védelmi Minisztérium nem akarja kinyitni laboratóriumait Kínának és Izraelnek, és fordítva. A közvélemény tudatosságának a nyitottság és a köz- és magánszféra közötti partnerség irányába kell irányítania a biztonságot.

Mi lesz a következő?

Dokumentumfilmkészítő vagyok, tehát természetesen a Végső találmányunk filmváltozatára gondolok.