Mindenki hallott a mesterséges intelligencia és különösen a gépi tanulás új fejleményeiről. Utópikus vagy apokaliptikus jóslatokat is hallottál arról, hogy mit jelentenek ezek az előrelépések. Arra ösztönözték őket, hogy akár a halhatatlanságot, akár a világ végét feltételezzék, és sokat írtak mind a két lehetőségről. De a legkifinomultabb AI még mindig messze van attól, hogy megoldja azokat a problémákat, amelyeket az emberi négyéves gyerekek könnyedén megoldanak. A lenyűgöző név ellenére a mesterséges intelligencia nagyrészt technikákból áll, amelyek segítségével statisztikai mintákat detektálhatnak nagy adathalmazokban. Sokkal több van az emberi tanulásnak.

Honnan tudhatunk annyit a körülöttünk lévő világról? Hatalmas összeget tanulunk még akkor is, amikor kicsi gyermekek vagyunk; a négyéves gyerekek már tudnak növényekről, állatokról és gépekről; vágyak, hiedelmek és érzelmek; még dinoszauruszok és űrhajók is.

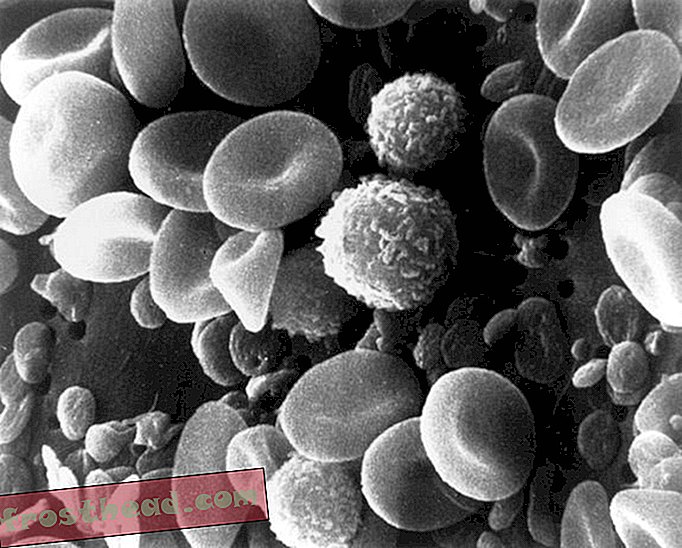

A tudomány kibővítette a világgal kapcsolatos tudásunkat a képzeletlenül nagy és végtelenül kicsivel, a világegyetem szélével és az idő kezdetével. Ezeket az ismereteket új osztályozások és előrejelzések készítéséhez használjuk, új lehetőségek elképzelésére és új dolgok előidézésére a világban. De minden, ami a világ bármelyikétől eléri, az a fotonok áramlása, amely eltalálja a retinainkat és zavarja a léggömböt a dobhártyánkon. Hogyan tanulhatunk annyit a világról, ha a rendelkezésre álló bizonyítékok annyira korlátozottak? És hogyan tehetjük meg mindezt a néhány font szürke goo-vel, amely a szemünk mögött ül?

A legjobb válasz eddig az, hogy agyaink számításokat végeznek az érzékelésünkhöz érkező konkrét, rendetlen adatokra, és ezek a számítások pontos képet mutatnak a világról. A reprezentációk strukturáltnak, elvontnak és hierarchikusnak tűnnek; magukban foglalják a háromdimenziós tárgyak észlelését, a nyelv alapját képező nyelvtanokat és a mentális képességeket, mint például az „elmeelmélet”, amely lehetővé teszi, hogy megértsük, amit mások gondolnak. Ezek a reprezentációk lehetővé teszik számunkra, hogy új előrejelzések széles skáláját készítsük és sok új lehetőséget elképzeljünk egy jellegzetesen kreatív emberi módon.

Ez a fajta tanulás nem az egyetlen intelligencia, hanem különösen fontos az emberek számára. És ez az a fajta intelligencia, amely a kisgyermekek különlegessége. Noha a gyermekek drámai módon rosszul tervezik és döntnek, a világ legjobb tanulói. Az adatok elméletekké alakításának folyamata nagyrészt az öt éves kor előtt történik.

Arisztotelész és Platón óta két alapvető módszer létezik a probléma kezelésére: hogyan tudjuk, amit tudunk, és ezek továbbra is a gépi tanulás fő megközelítései. Arisztotelész alulról felfelé megközelítette a problémát: Kezdje az érzékekkel - a fotonok és a levegő rezgéseinek (vagy a digitális kép vagy felvétel képpontjainak vagy hangmintainak) -, és nézze meg, lehetnek-e minták ezekből. Ezt a megközelítést tovább folytatják az olyan klasszikus társulások, mint a filozófusok David Hume és JS Mill, később pedig a viselkedéspszichológusok, mint például Pavlov és BF Skinner. Ebből a nézetből az ábrázolások absztrakt és hierarchikus struktúrája illúzió, vagy legalábbis epifenomen. Minden munkát asszociációval és mintázat-felismeréssel lehet elvégezni - különösen, ha elegendő adat van.

Lehetséges gondolkodásmód: Az AI 25 nézőpontja

John Brockman, a világ tudományos világának huszonöt legfontosabb tudományos elméje, az emberek, akik karrierjük nagy részében a mesterséges intelligencia területén gondolkodtak, páratlan kerekasztal-vizsgálatot folytattak az elme, a gondolkodás, az intelligencia és arról, hogy mit jelent légy ember.

megveszAz idő múlásával észrevehető volt ez a tanulási rejtély alulról építkező megközelítése és Platón alternatív, felülről lefelé mutató megközelítése között. Lehet, hogy absztrakt tudást kapunk konkrét adatokból, mert már sokat tudunk, és különösen azért, mert az evolúciónak köszönhetően már van egy sor elvont elvont fogalom. A tudósokhoz hasonlóan ezeket a fogalmakat felhasználhatjuk a világgal kapcsolatos hipotézisek megfogalmazására is. Ezután ahelyett, hogy megpróbálnánk kinyerni a mintákat a nyers adatokból, előrejelzéseket tudunk készíteni arról, hogy az adatoknak hogyan kell kinézniük, ha ezek a hipotézisek helytállóak. Platónnal együtt a „racionalista” filozófusok és pszichológusok, mint Descartes és Noam Chomsky, ezt a megközelítést alkalmazták.

Ez egy mindennapi példa, amely szemlélteti a két módszer közötti különbséget: a spam-pestis megoldása. Az adatok a beérkező levelek hosszú, válogatott üzenetekből állnak. A valóság az, hogy ezek közül az üzenetek közül néhány valódi, míg spam. Hogyan lehet az adatokat megkülönböztetni közöttük?

Először fontolja meg az alulról felfelé építkező technikát. Megállapítja, hogy a spam üzeneteknek jellemzői vannak: a címzettek hosszú listája, Nigériából származik, utalások millió dolláros nyereményekre vagy a Viagra. A probléma az, hogy a tökéletesen hasznos üzeneteknek is lehetnek ezek a funkciók. Ha elegendő példát nézetett a spam és a nem spam e-mailekre, akkor nemcsak azt láthatja, hogy a spam e-maileknek általában vannak ezek a szolgáltatások, hanem hogy a szolgáltatások általában különféleképpen működnek együtt (Nigéria plusz egy millió dolláros helyesírási probléma). Valójában lehet, hogy vannak finomabb, magasabb szintű összefüggések, amelyek megkülönböztetik a spam üzeneteket a hasznos üzenetektől - mondjuk a helyesírás és az IP-címek adott mintáját. Ha észleli ezeket a mintákat, kiszűrheti a levélszemét.

Az alulról építkező gépi tanulási technikák csak ezt teszik. A tanuló több millió példányt kap, mindegyikhez tartozik néhány funkciókészlet és mindegyik spam (vagy más kategória) címkével van ellátva, vagy sem. A számítógép kibonthatja a kettőt megkülönböztető tulajdonságok mintáját, még akkor is, ha ez elég finom.

Mi lenne a top-down megközelítés? Kapok egy e-mailt a Journal of Clinical Biology szerkesztőjétől. Ez utal az egyik cikkemre, és azt mondja, hogy szeretnék közzétenni egy cikkemet. Nincs Nigéria, nincs Viagra, nincs millió dollár; az e-mailnek nincs a spam egyik tulajdonsága sem. De felhasználva azt, amit már tudok, és elvont módon gondolkodva a spamet előállító folyamatról, kitalálhatom, hogy ez az e-mail gyanús:

1. Tudom, hogy a spamküldők megpróbálnak kinyerni pénzt az emberektől az emberi kapzsiságra való hivatkozással.

2. Tudom azt is, hogy a jogszerű „nyílt hozzáférésű” folyóiratok elkezdenek fedezni költségeiket az előfizetők helyett a szerzők díjazásával, és hogy én sem a klinikai biológiával foglalkozom.

Mindent összerakva készíthetek egy jó új hipotézist arról, hogy honnan jött az e-mail. Úgy tervezték, hogy az akadémikusok belemerüljenek egy cikk hamis folyóiratban való közzétételéhez. Az e-mail ugyanannak a kétes folyamatnak az eredménye, mint a többi spam e-mail, bár ez nem hasonlított rájuk. Csak egy példa alapján vonhatom le ezt a következtetést, és tovább folytathatom a hipotézisem tesztelését, a magán e-mailben leírtakon túlmenően, a „szerkesztő” googelésével.

Számítógépes szempontból egy „generatív modellel” kezdtem, amely olyan elvont fogalmakat tartalmaz, mint a kapzsiság és a megtévesztés, és leírja az e-mailes csalások előállításának folyamatát. Ez lehetővé teszi a klasszikus nigériai e-mail spam felismerését, de ezenkívül sokféle lehetséges spam elképzelését is lehetővé teszi. Amikor megkapom a napló e-mailt, visszaléphetek: "Ez csak olyan levélnek tűnik, amely egy spam-előállító folyamatból származna."

Az AI iránti új izgalom azért származik, mert az AI kutatói a közelmúltban mindkét tanulási módszer hatékony és hatékony verzióját készítették. De magukban a módszerekben nincs semmi mélyen új.

Alulról felfelé történő mély tanulás

A nyolcvanas években a számítógépes tudósok találékony módszert dolgoztak ki az adatok mintázatának észlelésére: kapcsolatok vagy neurális hálózatok architektúrája (a „neurális” rész metaforikus volt és ma is van). A megközelítés az 1990-es évek nehéz helyzetébe esett, de a közelmúltban olyan erős „mélyreható” módszerekkel újjáéledték, mint például a Google DeepMind.

Például adhat egy mélyreható tanulási programnak egy csomó internetes képet, feliratozva „macska”, mások „ház” feliratot és így tovább. A program képes felismerni a két képkészletet megkülönböztető mintákat, és felhasználhatja ezeket az információkat az új képek megfelelő címkézésére. Bizonyos típusú gépi tanulás, úgynevezett felügyelet nélküli tanulás, felismerheti az adatok mintáit, egyáltalán nem címkével; egyszerűen csak a jellemzők klasztereit keressék - amit a tudósok faktor elemzésnek hívnak. A mélyen tanuló gépekben ezeket a folyamatokat különböző szinteken megismételjük. Néhány program a pixelek vagy a hangok nyers adataiból is releváns funkciókat fedezhet fel; a számítógép először azáltal, hogy felismeri a nyers kép mintáit, amelyek megfelelnek az éleknek és a vonalaknak, majd megtalálja a mintákat azokban a mintákban, amelyek megfelelnek az arcoknak, és így tovább.

Egy másik, hosszú múltú alulról felfelé építkező technika a megerősítéses tanulás. Az 1950-es években a BF Skinner, John Watson munkájára építve, híresen programozta a galambokat, hogy bonyolult műveleteket hajtsanak végre - akár a légi eredetű rakétákat is irányítsák célpontjaikhoz (a közelmúltbeli AI zavaró visszhangja) azáltal, hogy külön jutalmazási és büntetési ütemtervet adtak nekik. . Az alapvető gondolat az volt, hogy a jutalmazott tevékenységeket meg kell ismételni, a büntetett tevékenységeket pedig nem, amíg a kívánt viselkedés el nem érkezik. Még Skinner idején is ez az egyszerű, újra és újra megismételt eljárás bonyolult viselkedéshez vezethet. A számítógépeket úgy tervezték, hogy egyszerű és egyszerű műveleteket végezzenek el olyan mértékben, amely elrontja az emberi képzeletét, és a számítási rendszerek rendkívül összetett képességeket tanulhatnak ilyen módon.

Például a Google DeepMind kutatói a mély tanulás és az erősítő tanulás kombinációját használtak arra, hogy megtanítsák a számítógépet az Atari videojátékok lejátszására. A számítógép semmit sem tudott a játékok működéséről. A véletlenszerű cselekedettel kezdődött, és csak arról kapott információt, hogy a képernyő miként néz ki minden pillanatban, és mennyire volt jól pontozva. A mély tanulás segített értelmezni a képernyőn megjelenő funkciókat, és a megerősítő tanulás jutalmazta a rendszert a magasabb pontszámokért. A számítógép nagyon jól tudott játszani néhány játékot, de teljesen bombázott másokat is, amelyeket ugyanolyan könnyű elsajátítani az emberek.

A mély tanulás és az erősítő tanulás hasonló kombinációja lehetővé tette a DeepMind AlphaZero programjának sikerét, amely mind a sakkban, mind a go-ban megpróbálta legyőzni az emberi szereplőket, és csak a játékszabályok alapvető ismereteivel és bizonyos tervezési képességekkel rendelkezik. Az AlphaZero-nak egy másik érdekes tulajdonsága van: Úgy működik, hogy több millió millió játékot játszik önmagával szemben. Ilyenkor elveszíti a veszteségekhez vezető hibákat, megismétli és kidolgozza a győzelemhez vezető stratégiákat. Az ilyen rendszerek, valamint a generatív, egymással versengő hálózatoknak nevezett technikákkal kapcsolatos adatok, valamint az adatok megfigyelése során generálnak adatokat.

Ha számítási képessége van arra, hogy ezeket a technikákat nagyon nagy adatkészletekre vagy milliónyi e-mail üzenetre, Instagram-képre vagy hangfelvételre alkalmazza, megoldhatja a korábban nagyon nehéznek tűnt problémákat. Ez a számítástechnika nagy izgalmának forrása. De érdemes emlékezni arra, hogy ezek a problémák - mint például annak felismerése, hogy egy kép macska vagy beszélt szó Siri - egy triviaális az ember számára. A számítástechnika egyik legérdekesebb felfedezése az, hogy a nekünk könnyen kezelhető problémák (például a macskák azonosítása) nehézek a számítógépek számára - sokkal nehezebbek, mint a sakk vagy a Go játék. A számítógépek millióinak példákra van szükségük az olyan objektumok kategorizálásához, amelyeket csak néhánygal kategorizálhatunk. Ezek az alulról felfelé építkező rendszerek általánosíthatók új példákra; meg tudják jelölni egy új képet macskaként, mindenki számára meglehetősen pontosan. De így tesznek, egészen más módon, mint az emberek általánosítják. Néhány képet, amely majdnem megegyezik egy macskaképpel, egyáltalán nem azonosítjuk macskának. Mások, amelyek véletlenszerű elmosódásnak tűnnek, lesznek.

Felülről lefelé Bayes modellek

A fentről lefelé mutató megközelítés nagy szerepet játszott az AI korai szakaszában, és a 2000-es években is valószínűségi vagy bayes generációs modellek formájában újjáéledt.

Ennek a megközelítésnek a korai kísérletei kétféle problémát vettek fel. Először is, a legtöbb bizonyítási mintázat elvileg sokféle hipotézissel magyarázható: Lehet, hogy a naplóem e-mail üzenete valódi, egyszerűen nem tűnik valószínűnek. Másodszor, honnan származnak a generációs modellek által használt fogalmak? Platón és Chomsky azt mondta, hogy velük születtél. De hogyan magyarázhatjuk meg, hogyan tanuljuk meg a tudomány legújabb fogalmait? Vagy hogy még a kisgyermekek is értik a dinoszauruszokat és rakétahajókat?

A Bayes-modellek egyesítik a generatív modelleket és a hipotézis tesztelést a valószínűség elmélettel, és ezekkel a két problémával foglalkoznak. A bayes-i modell segítségével kiszámolhatja, mennyire valószínű, hogy egy adott hipotézis igaz, az adatok alapján. És ha apró, de szisztematikus kísérleteket készítünk a már meglévő modellekről, és teszteljük őket az adatokkal szemben, időnként új fogalmakat és modelleket készíthetünk a régi modellekből. De ezeket az előnyöket más problémák ellensúlyozzák. A Bayes-féle technikák segítenek kiválasztani a két hipotézis közül melyik valószínűbb, de szinte mindig hatalmas számú lehetséges hipotézis létezik, és egyetlen rendszer sem képes hatékonyan megvizsgálni mindet. Hogyan dönt úgy, hogy mely hipotéziseket érdemes mindenekelőtt tesztelni?

A New York-i Brenden Lake és munkatársai ilyen típusú felülről lefelé fordított módszereket alkalmaztak egy másik probléma megoldására, amely az emberek számára könnyű, de a számítógépek számára rendkívül nehéz: ismeretlen kézírásos karakterek felismerése. Nézzen meg egy karaktert egy japán tekercsen. Még ha még soha sem látta, valószínűleg megmondja, hasonlít-e vagy eltér-e egy másik japán tekercs karakterénél. Valószínűleg rajzolhat, és akár egy hamis japán karaktert is megtervezhet a látott alapján - egy, amely nagyon különbözik a koreai vagy az orosz karaktertől.

Az alulról felfelé építkező módszer a kézzel írott karakterek felismerésére az, hogy mindegyikre példákat ad a számítógépnek, és hagyja, hogy kihúzza a legfontosabb tulajdonságokat. Ehelyett Lake et al. megadta a programnak a karakter rajzolásának általános modelljét: A stroke jobbra vagy balra megy; miután befejezte az egyiket, elkezdi a másikot; stb. Amikor a program egy adott karaktert látott, következtethet arra a stroke sorozatra, amely valószínűleg vezetett ahhoz - ugyanúgy, mint arra következtettem, hogy a spam folyamat a kétes e-mailhez vezette. Aztán meg tudja ítélni, hogy valószínűleg új karakter származik-e ebből a sorozatból vagy egy másikból, és maga is képes hasonló löket készíteni. A program sokkal jobban működött, mint egy pontosan ugyanazon adatokra alkalmazott mélytanulás program, és szorosan tükrözi az emberek teljesítményét.

A gépi tanulásnak ez a két megközelítése kiegészítő erősségekkel és gyengeségekkel rendelkezik. Az alulról felfelé építkező megközelítés szerint a programhoz nem kell sok ismerettel kezdeni, de nagyon sok információra van szüksége, és csak korlátozott módon képes általánosítani. A fentről lefelé mutató megközelítésben a program csak néhány példából tanulhat, és sokkal szélesebb és változatosabb általánosításokat készíthet, de kezdetben sokkal többet kell beépítenie. Számos nyomozó jelenleg próbálja összekapcsolni a két megközelítést, mély tanulással felhasználva Bayes-következtetéseket.

Az AI közelmúltbeli sikere részben e régi ötletek kibővítésének eredménye. De inkább az a tény, hogy az internetnek köszönhetően sokkal több adatunk van, és a Moore-törvénynek köszönhetően sokkal több számítási képességünk van arra, hogy ezeket az adatokat alkalmazzuk. Ráadásul nem értékelhető tény, hogy az általunk készített adatokat az emberek már rendezték és feldolgozták. Az interneten közzétett macskaképek kanonikus macskaképek - képek, amelyeket az emberek már "jó" képeknek választottak. A Google Fordító azért működik, mert kihasználja a több millió emberi fordítás előnyeit, és általánosítja őket egy új szövegrészre, ahelyett, hogy magukat a mondatokat valóban megértené.

De az igazán figyelemre méltó dolog az emberi gyermekek esetében az, hogy valamilyen módon egyesítik az egyes megközelítések legjobb tulajdonságait, és túlmutatnak rájuk. Az elmúlt tizenöt évben a fejlődő szakemberek megvizsgálták, hogy a gyerekek hogyan tanulják meg a struktúrát az adatokból. A négyéves gyerekek megtanulhatnak, ha csak egy vagy két példát vesznek az adatokból, ahogyan egy felülről lefelé irányuló rendszer teszi, és nagyon különböző fogalmakra általánosítják. De az adatokból új fogalmakat és modelleket is megtanulhatnak, mint az alulról építkező rendszer.

Például laboratóriumunkban kisgyermekeknek kapunk „blicket detector” -ot - egy új gépet kitalálni, amelyet még soha nem láttak. Ez egy doboz, amely akkor világít, és zenét játszik, amikor bizonyos tárgyakat rátesz, de másokra nem. Csak egy vagy két példát mutatunk a gyerekeknek a gép működéséről, megmutatva nekik, hogy két piros blokk teszi lehetővé, míg a zöld-sárga kombináció nem. Még a tizennyolc hónapos fiatalok azonnal kitalálják azt az általános alapelvet, miszerint a két objektumnak azonosnak kell lennie ahhoz, hogy megvalósuljon, és általánosítják ezt az elvet új példákra: Például két objektumot választanak, amelyek azonos alakúak a gép működik. Más kísérletekben kimutattuk, hogy a gyerekek még azt is kitalálhatják, hogy valami rejtett láthatatlan tulajdonság miatt a gép elindul, vagy hogy a gép valamilyen elvont logikai elven működik.

Ezt megmutathatja a gyermekek mindennapi tanulásában is. A kisgyermekek gyorsan megtanulják a biológia, a fizika és a pszichológia absztrakt intuitív elméleteit ugyanúgy, mint a felnőtt tudósok, még viszonylag kevés adat mellett.

A legújabb AI rendszerek figyelemre méltó gépi tanulási eredményei - alulról felfelé és fentről lefelé - egy hipotézisek és fogalmak szűk és jól meghatározott térében zajlanak - pontos játékdarabok és mozogások, előre meghatározott képkészlet . Ezzel szemben a gyermekek és a tudósok néha radikális módon változtatják meg fogalmaikat, a paradigmaváltások végrehajtása helyett a már meglévő fogalmak egyszerű megváltoztatása.

A négyéves gyerekek azonnal felismerik a macskákat és megértik a szavakat, de kreatív és meglepő következtetéseket vonhatnak le, amelyek messze meghaladják a tapasztalataikat. A saját unokám például nemrégiben elmagyarázta, hogy ha egy felnőtt újra gyermeke akar lenni, akkor meg kell próbálnia nem fogyasztni egészséges zöldséget, mivel az egészséges zöldség miatt a gyermek felnőttké válik. Ez a hipotézis, amely valószínű, hogy a felnőttek soha nem szórakoznának, a kisgyermekekre jellemző. Valójában kollégáimmal és én szisztematikusan megmutattuk, hogy az óvodások jobban reagálnak valószínűtlen hipotézisekre, mint az idősebb gyermekek és felnőttek. Szinte fogalmunk sincs arról, hogy miként lehetséges ez a kreatív tanulás és innováció.

Ha megvizsgáljuk, hogy mit tesznek a gyermekek, hasznos tippeket adhat a programozóknak a számítógépes tanulás irányaival kapcsolatban. A gyermekek tanulásának két vonása különösen feltűnő. A gyermekek aktív tanulók; nem csak passzív módon vesznek fel adatokat, mint az AI-k. Ahogyan a tudósok kísérleteznek, a gyermekeket alapvetően motiválja az is, hogy végtelen játék és felfedezés útján nyerjen információkat az őket körülvevő világból. A legújabb tanulmányok azt mutatják, hogy ez a feltárás szisztematikusabb, mint amilyennek látszik, és jól alkalmazkodik ahhoz, hogy meggyőző bizonyítékokat találjon a hipotézis kialakulásának és az elmélet megválasztásának alátámasztására. A kíváncsiság építése a gépekbe és a világgal való aktív interakció lehetővé tétele lehet reálisabb és széles körű tanuláshoz vezető út.

Másodszor: a meglévő AI-kkel ellentétben a gyermekek társadalmi és kulturális tanulók. Az emberek nem elszigetelten tanulnak, hanem élvezik a múlt nemzedékek felhalmozódott bölcsességét. A legfrissebb tanulmányok azt mutatják, hogy még az óvodások is megtanulják utánozni és mások bizonyságát hallgatni. De nem csak passzív engedelmeskednek tanáraiknak. Ehelyett figyelemre méltóan finoman és érzékeny módon veszik be mások adatait, összetett következtetéseket vonnak le arról, hogy honnan származik az információ és mennyire megbízhatóak, és szisztematikusan integrálják saját tapasztalataikat az általuk hallottal.

A „mesterséges intelligencia” és a „gépi tanulás” félelmetesnek tűnik. És bizonyos értelemben ezek is. Ezeket a rendszereket például fegyverek vezérlésére használják, és tényleg félnünk kellene ettől. A természetes hülyeség azonban még inkább pusztíthat, mint a mesterséges intelligencia; mi embereknek sokkal okosabbnak kell lennünk, mint a múltban voltunk az új technológiák megfelelő szabályozása érdekében. De sem az apokaliptikus, sem az utópisztikus látás az AI-k helyett nem helytálló. Amíg meg nem oldjuk a tanulás alapvető paradoxonját, a legjobb mesterséges intelligencia nem lesz képes versenyezni az átlagos négyéves emberekkel.

A leendő gyűjteményből LEHETSÉGES SZELEK: 25 út az AI-hez, szerkesztette John Brockman. Megjelent a Penguin Press-szal, a Penguin Random House LLC tagjával kötött megállapodás alapján. Szerzői jog © 2019 John Brockman.